印章三折頁設計圖鑒 高效傳遞各類廣告信息的藝術

在數字營銷盛行的今天,實體宣傳物料依然以其獨特的觸感和視覺沖擊力占據一席之地。其中,印章三折頁作為一種兼具實用性與創意性的載體,巧妙地將企業形象、產品信息與廣告宣傳融為一體,成為各類廣告活動中引人注目的亮點。

一、 印章三折頁:傳統工藝與現代設計的交融

印章三折頁,顧名思義,是將傳統的印章元素與標準的三折頁版式相結合的宣傳品。其核心在于一枚精心設計的印章圖案,它不僅是視覺焦點,更是品牌精神的凝結。這枚印章可以蓋印在折頁的封面、內頁或特定位置,通過凹凸的質感、獨特的印泥顏色(如經典紅、沉穩金、商務藍等),瞬間提升物料的品質感和記憶點。三折頁的折疊形式則提供了層次分明的信息展示空間,引導讀者逐步深入閱讀。

二、 適配各類廣告場景的設計與應用

- 品牌形象廣告:適用于企業開業、周年慶或品牌升級。印章常采用企業LOGO的變體或核心圖騰,配以簡潔大氣的版面設計,傳遞穩重、可信賴的品牌氣質。內頁可闡述品牌故事、理念與文化。

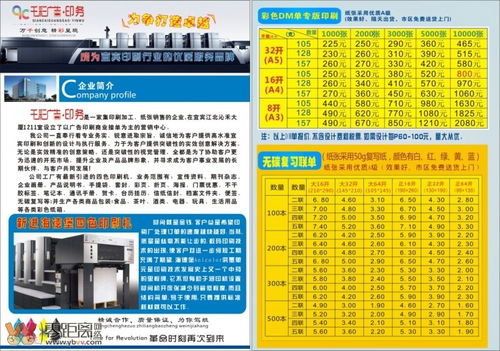

- 產品推廣廣告:針對新品發布或重點產品推介。印章可設計為產品造型或核心賣點的圖標化表達。三折頁內頁系統展示產品特點、技術參數、應用場景及客戶案例,印章的“蓋章”意象暗含“品質認證”的寓意。

- 活動宣傳廣告:用于展會、研討會、促銷活動的預告與邀請。印章可以作為活動主題的視覺符號,日期、地點等關鍵信息亦可融入印章設計之中,極具儀式感和收藏價值,能有效提升活動的參與率和關注度。

- 服務方案廣告:常見于咨詢、金融、法律、設計等服務行業。印章代表專業的承諾與蓋章確認。三折頁內頁清晰羅列服務流程、優勢及成功案例,通過有形的印章強化服務可信度的無形承諾。

三、 設計要點與視覺呈現

一張出色的印章三折頁圖片,需在視覺上實現平衡與吸引:

- 印章設計:力求圖形簡潔、寓意深刻,避免復雜細節在蓋印時模糊。考慮與整體版式的構圖關系,是居中凸顯,還是作為角標點綴。

- 版面布局:遵循三折頁的閱讀邏輯(封面吸引→內頁展開→封底行動號召),合理分配圖文。留白藝術至關重要,避免信息過載。

- 色彩與字體:色彩體系通常從印章色延伸,保持整體協調。字體選擇需符合廣告調性,標題可具藝術感,正文則確保清晰易讀。

- 材質與工藝:選擇適宜紙張(如質感棉紙、高級卡紙)來承托印章的質感。除了傳統蓋印,也可采用燙金、UV、擊凸等現代印刷工藝模擬印章效果,更利于大批量制作。

四、

印章三折頁超越了普通宣傳單頁的功能,它將一份廣告變為一件可觸摸、可品鑒的“品牌信物”。在各類廣告戰役中,它以其獨特的文化韻味和扎實的物理存在感,在瞬間吸引眼球的更致力于在受眾心中烙下深刻、持久的品牌印記。設計得當的印章三折頁,不僅是信息的傳遞者,更是品牌與消費者之間建立情感聯結的巧妙橋梁。

如若轉載,請注明出處:http://www.hbjsgg.cn/product/69.html

更新時間:2026-03-09 18:08:49